Inhaltsverzeichnis

Begriffsdefinition

Ein System wird erst dann als autonom bezeichnet, wenn es ohne menschliche Steuerung oder detaillierte Programmierung ein vorgegebenes Ziel selbstständig und an die Situation angepasst erreichen kann. [FACH17]

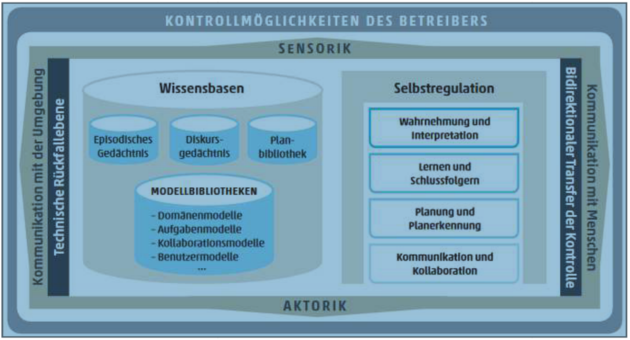

Das System ist fähig, die Umgebung über Sensoren wahrzunehmen, proaktiv und situationsgerecht einen angemessenen Handlungsplan zu generieren und über Aktoren sicher und zuverlässig auszuführen. In intensiver Abstimmung zwischen Wissenschaft und Industrie wurde ein Entwurf für eine Referenzarchitektur erarbeitet, der die drei wesentlichen Komponenten autonomer Systeme - Sensorik, Selbstregulation und Aktorik - fokussiert. Mit den Elementen der Wahrnehmung und Interpretation, der Planung und Planerkennung, des Lernens und Schlussfolgerns sowie der Kommunikation und Kollaboration wird die Selbstregulation eines autonomen Systems ermöglicht. (siehe Abbildung 1) [FACH17]

Einordnung in den Kontext

Bis vor kurzem galten autonome Fahrzeuge wie das Tesla „Model S“ als Zukunft der Personenmobilität. Neben einem Komfortgewinn versprach man sich vor allem eine niedrigere Umweltverschmutzung und einen Anstieg der Verkeehrssicherheit, da 90 Prozent aller Verkehrsunfälle auf menschliche Fehler zurückzuführen sind. Der Mensch müsse das Fahrzeug nur noch überwachen und könne sich während der Fahrt anderen Aufgaben widmen. Doch einige Unfälle von autonom fahrenden Tesla „Model S“warfen zum einen sicherheits- und haftungsrechtliche, aber auch versicherungsrechtliche Fragen auf. Während die technische Entwicklung autonomer Fahrzeuge in den letzten Jahren enorme Fortschritte gemacht hat, steht die versicherungsrechtliche Diskussion noch am Anfang.

Einem autonomen System ist es immanent, dass es Handlungen selbst ausführt und vom Menschen nicht ununterbrochen kontrolliert wird. An der grundsätzlichen Verantwortlichkeit des Menschen für ein solches System ändert zwar selbst ein hoher Automatisierungsgrad nichts. Es stellt sich aber die Frage, wie sich der Sorgfaltsmaßstab zwischen Herstellern, Nutzern und Dritten bei der Herstellung und Nutzung autonomer Systeme verschiebt. [HoKa16] Können die Beteiligten auf die selbsthandelnde Technik blind vertrauen?

Eine weitere große Fragestellung betrifft das haftungsrechtliche System der Risikozuweisung für Fehlentscheidungen autonomer Systeme. Auf der Grundlage des heutigen Stands der Technik muss die These hinterfragt werden, dass Hersteller oder Betreiber autonomer Systeme mangels Vorhersehbarkeit von Fehlentscheidungen nach den Grundsätzen der Verschuldenshaftung oder der Produkthaftung nicht haftbar gemacht werden könnten. Eine Möglichkeit ist der Rückgriff auf das Konzept der Gefährdungshaftung, bei der die Gesellschaft bestimmte Verhaltensweisen trotz ihrer Gefährlichkeit aufgrund ihrer sozialen Nützlichkeit erlaubt. [Grüt16]

Beispiele

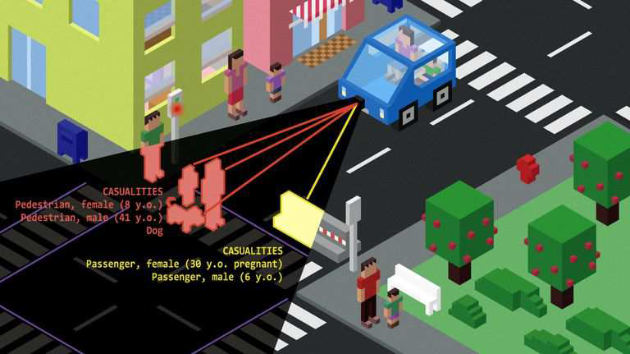

Ein konkretes Beispiel für rechtliche Herausforderungen autonomer Systeme ist die sogenannte Kill-Frage bei einem Fahrzeugunfall mit einem autonom fahrenden Auto. Ein Fahrzeug fährt auf einen Vater mit seinem Kind und einem Hund zu und kann nicht mehr rechtzeitig bremsen. Es hat lediglich die Möglichkeit auszuweichen und wird dann allerdings mit einer Betonmauer zusammenstoßen, sodass die eigenen Insassen - eine schwangere Frau mit ihrem Sohn - zu Schaden kommen werden. (Abbildung 2)

Der Computer muss also entscheiden, welcher Mensch verletzt wird oder sogar stirbt. Der Fahrzeugrechner hat Ablauf und Folgen des Unfalls berechnet und seine Entscheidung anhand vorab definierter Kriterien entschieden. Doch wie lauten diese Kriterien und wer legt sie fest? Die Ingenieure, die das Fahrzeug entwickelt haben? Der Fahrzeughalter, der bei Übernahme des Fahrzeugs bestimmte Kriterien anhand seiner ethischen Vorstellung in das Fahrzeug einprogrammiert hat? Oder vielleicht doch der Gesetzgeber aufgrund gesellschaftlicher Vorgaben?

Allein dieses Beispiel zeigt wie viele Fragen für den rechtlich sicheren Einsatz von autonomen Systemen wie autonom fahrenden Fahrzeugen noch zu klären sind. Vor allem bedarf es einer gesellschaftlichen Debatte zum Umgang mit diesen Systemen.

Literatur

- [Fach17] Fachforum Autonome Systeme im Hightech-Forum: Autonome Systeme - Chancen uns Risiken für Wirtschaft, Wissenschaft und Gesellschaft, Langversion, Abschlussbericht, Berlin, April 2017

- [Grüt16] Dr. M. Grützmacher: Die deliktische Haftung für autonome Systeme - Industrie 4.0 als Herausforderung für das bestehende Recht?, CR 2016 Heft 1, 695

- [HoKa16] S. Horner, M. Kaulartz: Haftung 4.0 - Verschiebung des Sorgfaltsmaßstabes bei Herstellung und Nutzung autonomer Systeme, CR 2016 Heft 1, 7-14

- Abb 1: Deutsches Forschungszentrum für Künstliche Intelligenz, 2017

- Abb 2: https://hips.hearstapps.com/pop.h-cdn.co/assets/16/25/2048x1151/gallery-1466704004-self-driving-dil.jpg?resize=768:* (Abrufdatum: 07.02.18)